С развитием искусственного интеллекта в Сети стали все больше создавать ролики и изображения с помощью ИИ. Причем отличить их от настоящих становится все сложнее. Однако у сгенерированных изображений все еще остаются «следы», по которым можно вычислить происхождение. Пока в мире генерируют очередные фальшивые кадры катастроф и якобы подробности сенсаций, рассказываем, что нужно знать, чтобы отличить контент ИИ от настоящего.

Чрезмерное количество пальцев или зубов

Одна из главных ошибок нейросетей, которую пока не удалось полностью перебороть, – неправильная анатомия. Некоторые авторы уже учитывают способности нейросетей «приделать» субъекту лишний палец и прописывают необходимое количество в промптах. Однако для создания вирусного ролика в соцсетях и обогащения многие креаторы не уделяют этому внимание. Запомните: если у вас вызывает сомнение реальность изображенного на фото или видео человека, приблизьте картинку и пересчитайте количество пальцев на руках. Еще один верный маркер – зубы: часто нейросети рисуют слишком много зубов, они неестественно одинаковы или недостаточно детализированы (в результате образуют сплошную белую линию).

Чересчур гладкая кожа

Этот баг особенно заметен на фотографиях якобы крупным планом. На снимке кожа выглядит идеально ровной: нет ни пор, ни морщин, ни естественной структуры. На сгенерированных фото даже пожилые люди выглядят как фарфоровые куклы или после сильной ретуши. Обратите внимание на эти тонкости, а также проанализируйте распределение света и теней. На реальных фото тени падают в одном направлении, а в сгенерированных изображениях они могут «идти» в разные стороны. Это может пролить свет на происхождение даже якобы портретных фотографий, где ИИ более внимательно «рисует» кожу модели.

Надписи на вымышленном языке

Известный факт – нейросети не слишком хорошо генерируют изображения с текстом. Поэтому на вывесках, плакатах, упаковке или одежде можно увидеть набор странных букв (они напоминают рунические символы) или слова, написанные на вымышленном языке. А еще текст может быть частично «размазанным»: нейросети не могут делать его достаточно четким. Это один из самых распространенных признаков AI-изображений.

Искаженные детали на заднем плане

Специалисты по генерации контента отмечают, что часто ИИ хорошо «прорисовывает» центральный объект и забывает про задний план. В результате на фоне появляются искривленные окна, несуществующие архитектурные здания и перекошенные машины. Если действие происходит среди людей, у окружающих могут быть недостаточно прорисованные или одинаковые лица. Эти визуальные ошибки помогут определить истинное происхождение изображения.

Фото: Vinur / pexels.com

Странные отражения в зеркалах и стекле

Что-что, а отражения в зеркалах генеративные модели пока не освоили. Поэтому наличие зеркала или стекла в кадре – ваш «маячок». Обратите внимание, как человек на фото выглядит в зеркале: на генерированных ИИ изображениях он отличается или вовсе отсутствует.

«Слияние» объектов

Еще один маркер сгенерированного ИИ контента – так называемые «гибриды» предметов, когда один предмет плавно переходит в другой. В итоге получается то ли переосмысление картин Сальвадора Дали, то ли отсебятина с некачественным изображением. Чтобы отличить ИИ-контент от настоящего, вглядитесь в детали: как выглядят украшения на шее и руках, хорошо ли прорисованы ручки сумки и других аксессуаров.

Неправдоподобные движения в видео

Этот метод больше подойдет для видео. В созданных ИИ роликах движения людей и животных могут показаться слишком плавными. Из-за этого субъекты видео напоминают резиновых человечков, у которых то странно сгибаются руки, то меняется форма пальцев, то исчезает деталь одежды. Чтобы отследить эти изменения, попробуйте замедлить видео и пересмотреть его еще раз.

Отсутствие других фото с события

Если вы увидели фото или видео якобы с крупного события, например с места катастрофы или выступления известного политика, не торопитесь верить своим глазам. Попробуйте поискать в Интернете другие кадры с этих событий: обычно важнейшие происшествия снимают десятки людей с разных ракурсов.

Также помните: громкие события быстро освещаются СМИ. Если случилось что-то сенсационное, например историческое здание разрушилось или какой-то политик был арестован, проверьте новостные сайты. Если ни в одном авторитетном источнике нет информации, скорее всего, вы наткнулись на фейк. Будьте внимательны: часто социальные сети не ответственны за публикацию ложной информации, поэтому им верить не стоит.

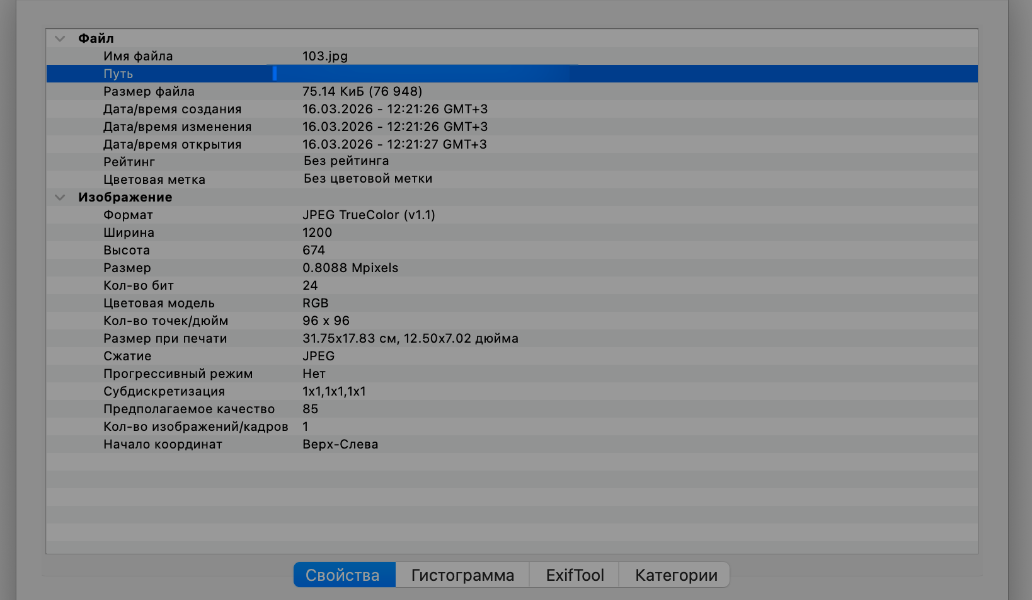

Подозрительные метаданные

Если вы можете сохранить фото на свое устройство, то, скорее всего, у вас получится проверить его изображение на смартфоне или компьютере. Дело в том, что у настоящих фотографий можно увидеть сохраненные метаданные – дату съемки, параметры экспозиции и даже модель камеры, на которую сделан снимок. А вот у сгенерированных картинок наверняка не будет «вшитых» метаданных. Или они могут представлять собой бессвязный набор слов.

мы в дзене

мы в дзене